Capteur de vision logiciel

Le premier logiciel évolutif basé sur des caméras

pour l’avenir de la mobilité.

Nous augmentons l’autonomie des robots mobiles et des opérateurs de machines en leur fournissant le sens commun visuel dont ils ont besoin pour naviguer.

Ce que nous proposons

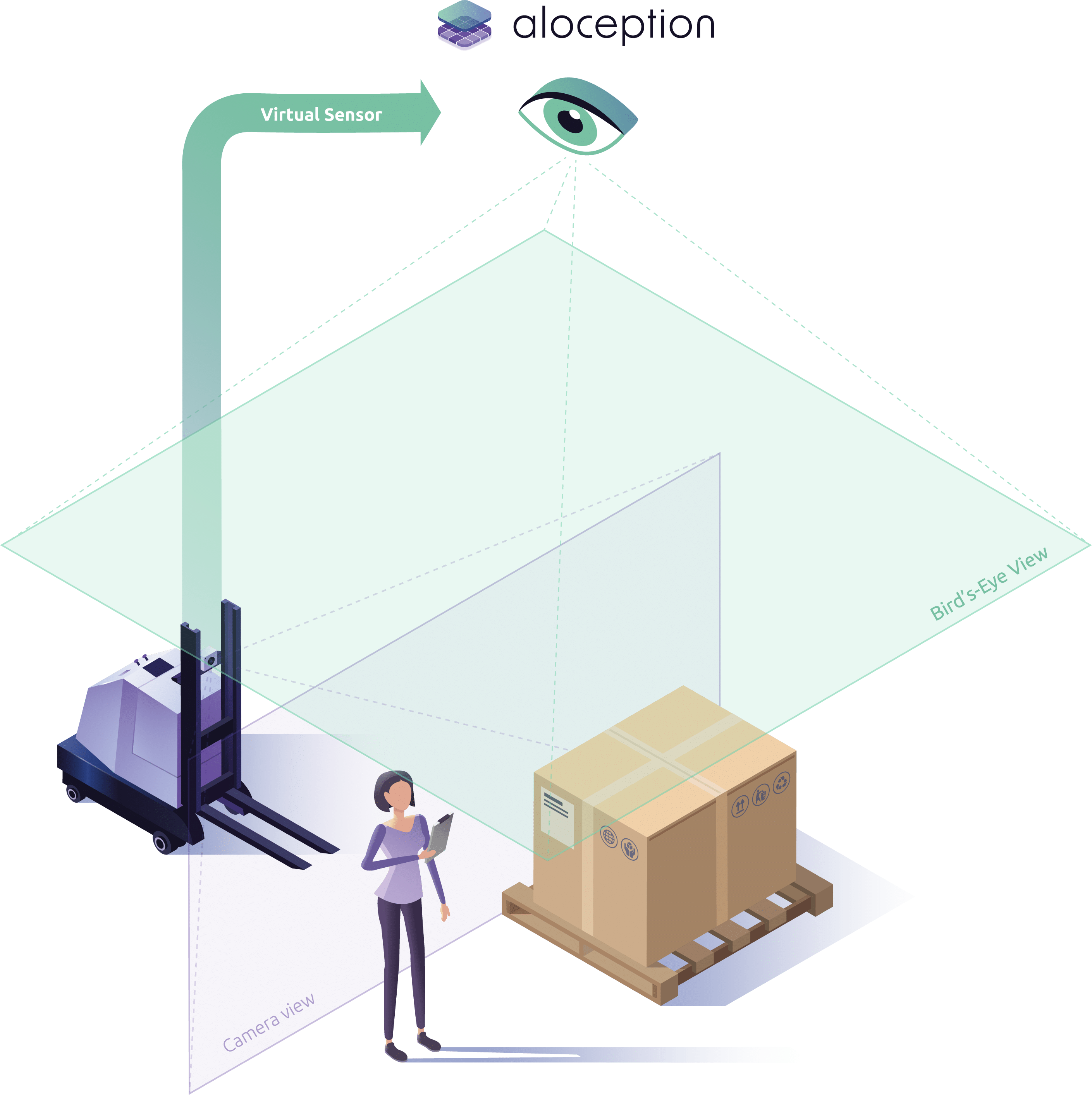

Aloception Bird’s-Eye View

Alors que les caméras traditionnelles ne voient que ce qui se trouve devant elles, la vue d’oiseau d’Aloception fournit une représentation unique, complète et enrichie d’une scène.

Découvrez Aloception avec l’ADK

L’ADK est un capteur de vision logiciel Plug & Play, disponible pour tester Aloception sur vos propres robots.

Nous sommes là où l’observation est la clé

CEUX QUE NOUS AIDONS

Le futur de la mobilité

La généricité permet l’adaptabilité. Avec la même technologie de base et une stratégie transversale, Aloception contribue à façonner l’avenir de la mobilité en s’adressant à deux marchés majeurs.

Mobilité autonome

Aloception offre un ensemble d’informations de grande valeur directement utilisables par les fabricants de robots dans le cadre de tâches ciblées pour l’utilisateur final.

Les fabricants de robots peuvent maximiser le retour sur investissement des robots en augmentant leur taux de disponibilité grâce à la détection précoce des situations de blocage.

Mobilité assistée

Aloception est conçu pour aider les conducteurs de véhicules lourds et les opérateurs de machines à mieux comprendre leur environnement.

Les opérateurs peuvent réduire le nombre de situations dangereuses qu’ils rencontrent, tout en augmentant leur confort d’utilisation.

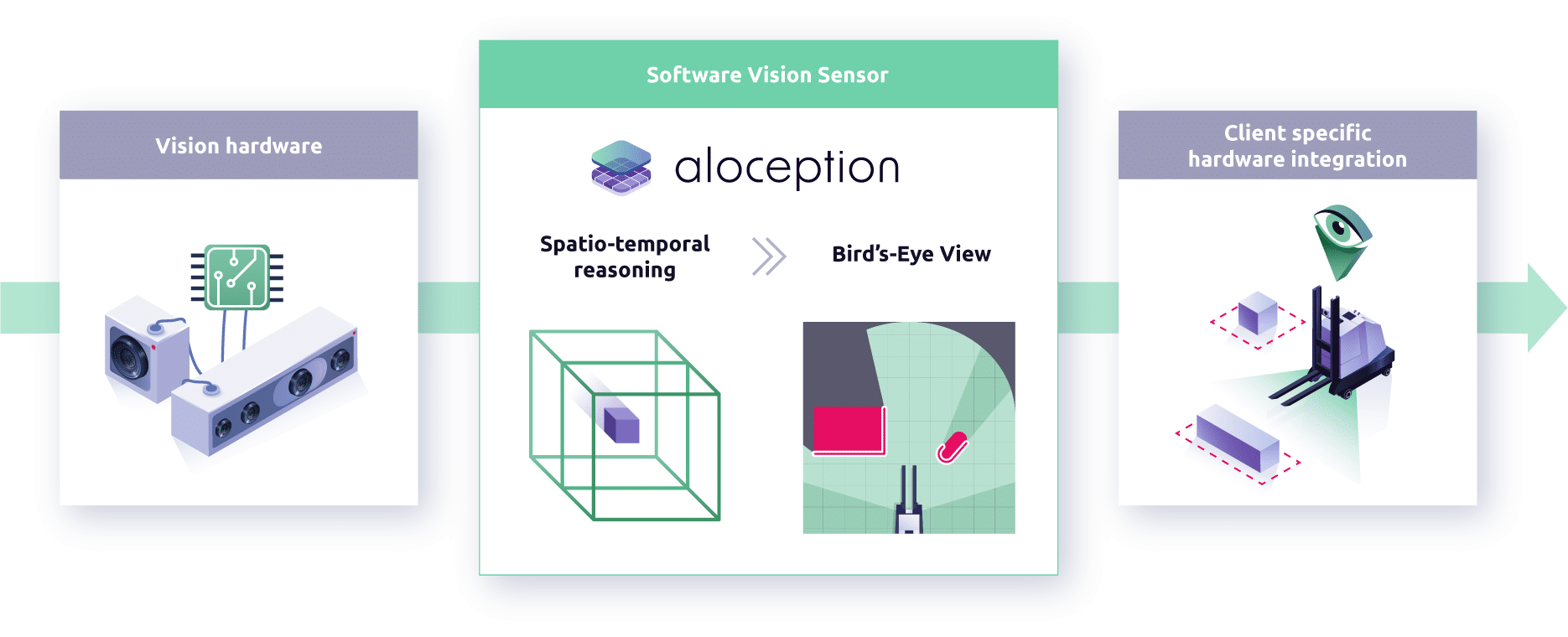

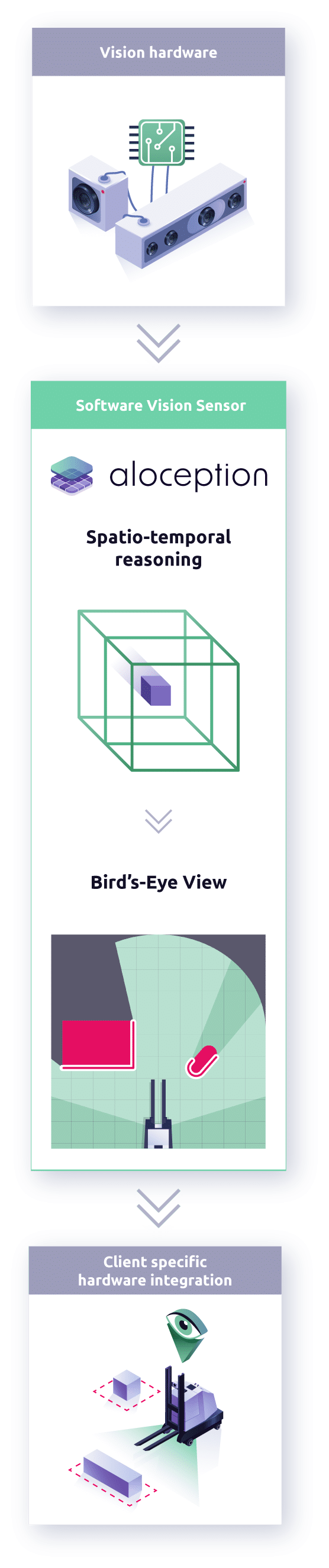

Comment nous procédons

Les enfants marchent avant de communiquer

Comme un enfant qui sait naviguer autour d’une chaise et d’un chien avant de connaître leurs noms, Aloception se concentre sur la profondeur et la compréhension géométrique de l’environnement plutôt que sur l’aspect sémantique des choses.

Uniquement par caméra

Monoculaire, stéréo, fisheye, ToF

Architecture unifiée

Calibrage et fusion automatiques des capteurs

Raisonnement spatio-temporel

Analyse temporelle et géométrique pour plus de robustesse

Compréhension légère en temps réel

Système embarqué et formulation récurrente

Les humains naviguent avec leurs yeux, le reste se passe dans le cerveau.

Nous sommes concentrés sur le cerveau, pas sur les capteurs supplémentaires.

Qui sommes-nous ?

Une équipe ambitieuse et créative

Fondée en 2020 par Rémi Agier et Thibault Neveu, Visual Behavior compte aujourd’hui 15 personnes créatives et passionnées par la résolution de problèmes d’observation pour la robotique.

En nous appuyant sur notre vaste expérience dans les domaines des sciences cognitives, de la vision par ordinateur et de l’ingénierie robotique, nous avons à coeur d’aider les entreprises du secteur de la mobilité intelligente en leur fournissant une solution de compréhension de scène évolutive et abordable.

Rémi AGIER

PDG et cofondateur

Thibault NEVEU

Directeur technique et co-fondateur